Борислав Козловский - Максимальный репост. Как соцсети заставляют нас верить фейковым новостям

- Название:Максимальный репост. Как соцсети заставляют нас верить фейковым новостям

- Автор:

- Жанр:

- Издательство:Литагент Альпина

- Год:2018

- Город:Москва

- ISBN:978-5-9614-7108-3

- Рейтинг:

- Избранное:Добавить в избранное

-

Отзывы:

-

Ваша оценка:

Борислав Козловский - Максимальный репост. Как соцсети заставляют нас верить фейковым новостям краткое содержание

Максимальный репост. Как соцсети заставляют нас верить фейковым новостям - читать онлайн бесплатно ознакомительный отрывок

Интервал:

Закладка:

И соцсети, и поисковики активно помогают нам изолировать себя от непохожих мнений – вроде мнений сторонников цензуры. Три года назад вышла книга американского левого активиста Эли Паризера «Пузырь фильтров» с подзаголовком «Как новый персонализированный интернет влияет на то, что мы читаем и что мы думаем» {95} 95 На русский язык название книги перевели как «За стеной фильтров. Что интернет скрывает от вас» (М.: Альпина Бизнес Букс, 2012), что не вполне точно отражает смысл: понятие «информационные пузыри» уже прижилось в Рунете.

.

Когда сосед из квартиры сверху и вы одновременно заходите на главную страницу Google, поисковая выдача по одному и тому же запросу у вас будет разной – начиная с 2009 года Google подстраивает ее под ваши интересы. Например, по слову «Форд» поисковик выдаст вам биографию Генри Форда, а соседу – страницу салона, где торгуют автомобилями. То же самое, утверждает Паризер, касается и проблемных тем. Если вы параноидально боитесь ГМО, то на первой странице поисковой выдачи будут преобладать сайты про вред «еды Франкенштейна», а если вы биотехнолог – то ресурсы с более рациональным взглядом на вещи.

Механизм фильтров Facebook – тот самый, который из 1500 записей оставляет 300 наиболее интересных – можно обвинить даже в политической цензуре. Он – буквально как российские телеканалы – ограничивает доступ к новостям, которые идут вразрез с политическими убеждениями аудитории. Таков вывод в научной статье, опубликованной в журнале Science командой из исследовательского отдела Facebook и Мичиганского университета {96} 96 Bakshy, E., S. Messing, and L. A. Adamic. “Exposure to Ideologically Diverse News and Opinion on Facebook.” Science 348, no. 6239 (2015): 1130–132. doi:10.1126/science.aaa1160.

.

Исследователи Эйтан Бакши, Соломон Мессинг и Лада Адамич проанализировали ленты 10,1 млн пользователей из США, которые явно указали в профиле свою политическую позицию. Для простоты все многообразие взглядов свели к трем категориям: получилось 4,1 млн «либералов», 1,6 млн «умеренных» и 4,4 млн «консерваторов».

Ученые следили за тем, как эти пользователи делились друг с другом новостями в течение шести месяцев (с 7 июля 2014 года по 7 января 2015-го). И, главное, кто какие новости видел у себя в ленте.

7 млн различных новостных публикаций, которые появлялись в лентах у пользователей в течение полугода, разделили на «мягкие» (спорт, путешествия и так далее) и «жесткие» (то, что газеты обычно печатают в разделах «Общество», «Политика» и «В мире»). В эту последнюю категорию попало 13 % всех ссылок. Ключевые слова, по которым такие статьи вычисляли, – «война», «аборты», «образование», «безработица», «иммиграция», «выборы» и так далее. В конце концов авторы сконцентрировались на судьбе тех 226 тысяч «жестких» публикаций, каждую из которых перепостили как минимум двадцать человек с заявленными в профиле политическими взглядами.

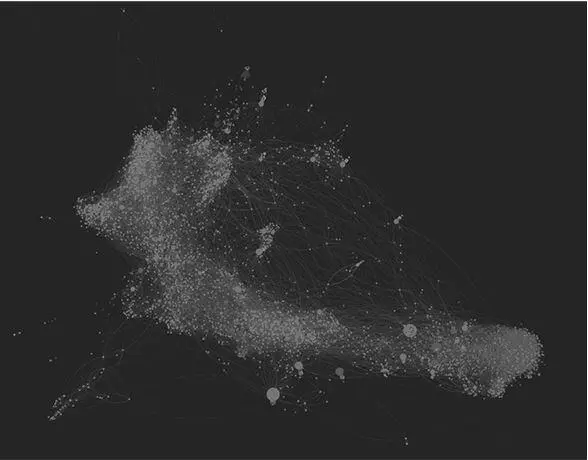

Рис. 7.Информационные пузыри: сторонники Трампа и Клинтон в социальном графе Twitter перед президентскими выборами в США. На карте, которая показывает результаты проекта Electome, запущенного MIT Media Lab {97} 97 http://www.electome.org .

, видно, что консерваторы предпочитают общаться с консерваторами, а либералы – с либералами, и в итоге оказываются изолированы от оппонентов

Тут же выяснилось, что у либералов свои новости, а у консерваторов – свои. Вместо того чтобы обсуждать одни и те же статьи с разных позиций, люди противоположных политических убеждений делают акцент на разных событиях и возмущаются каждый своими несправедливостями. Условно говоря (если распространить выводы на российский сегмент Facebook), одни больше пишут про «события 6 мая на Болотной», другие – про «жертв 2 мая в Одессе».

Само собой, источники цитируются тоже разные: если вы увидели ссылку на FoxNews.com, с вероятностью 80 % можно утверждать, что ею поделился консерватор. А на HufifngtonPost.com, наоборот, в 65 % случаев ссылаются либералы.

И оба потока новостей, «консервативный» и «либеральный», в соцсетях активно фильтруются.

Первая линия цензуры – это отбор, который проделывают за нас друзья: мы склонны окружать себя людьми похожих политических взглядов. Как сосчитали авторы исследования, в среднем у пользователей-либералов всего 20 % друзей – консерваторы. Ну и, разумеется, среди друзей среднестатистического консерватора только 18 % составляют либералы.

Если бы френдлента формировалась из случайных записей, то в среднем 45 из 100 новостей, которые видит пользователь-либерал, вступали бы в конфликт с его картиной мира. Но в реальности – поскольку друзья придерживаются похожих взглядов и перепощивают отнюдь не все подряд – таких «конфликтных» новостей оказывается всего 24 из 100.

Забавно, что картина мира консерваторов искажается слабее: вместо 40 % неприятных новостей после «цензуры друзей» остается 35.

К этим цифрам загадочные алгоритмы Facebook и злая воля Марка Цукерберга лично не имеют никакого отношения: пока речь только о том, как на новостную картину дня влияет наш выбор друзей. Чем они делятся – то мы и видим. Рассуждения не изменятся, если вместо Facebook взять «Живой журнал», «ВКонтакте», «Одноклассников» или клубы по интересам в реальном мире.

Другое дело, что Facebook жестко прореживает нашу ленту, пытаясь по прежним лайкам предсказать, что из нового контента нас заинтересует, а что нет. Происходит ли на этой стадии непроизвольная политическая цензура? Да, происходит: мы чаще лайкаем то, что хорошо согласуется с нашими убеждениями, – и для умных алгоритмов соцсети это не секрет. Поэтому, когда Facebook пытается выдать нам как можно меньше неинтересного, доля «конфликтных» новостей у либералов падает еще на 8 %, а у консерваторов – на 5 %.

Наконец, ссылка на новость в ленте еще не означает, что эта новость будет прочитана. Третья линия цензуры – наш собственный выбор: если даже новость из другого лагеря преодолела первые два барьера («цензуру друзей» и «цензуру алгоритма») и все-таки просочилась в ленту, то для консерватора вероятность кликнуть по такой ссылке на 17 % ниже среднего, а для либерала – на 6 %.

Бакши и его коллеги подчеркивают, что в каскаде идеологических фильтров роль алгоритмов не такая уж большая. За невозможностью узнать чужую точку зрения стоит, прежде всего, наша свободная воля. Что может быть естественнее желания читать единомышленников и нежелания лайкать то, что расходится с устоявшимися взглядами? Получается парадокс: если предоставить пользователям полную свободу доступа к информации – мы приложим максимум усилий, чтобы себя дезинформировать.

Соцсети – еще не крайний случай. Авторы сравнивали сеть дружеских связей в Facebook с сетью политических блогов перед президентскими выборами 2004 года в США – и констатировали, что в блогах сами собой возникают изолированные друг от друга «кластеры единомыслия», где никакого реального разнообразия мнений нет.

Читать дальшеИнтервал:

Закладка:

![Роберт Лихи - Не верь всему, что чувствуешь. Как тревога и депрессия заставляют нас поверить тому, чего нет [litres]](/books/1149058/robert-lihi-ne-ver-vsemu-chto-chuvstvuesh-kak-tre.webp)