Александр Сотов - Компьютерная информация под защитой. Правовое и криминалистическое обеспечение безопасности компьютерной информации. Монография

- Название:Компьютерная информация под защитой. Правовое и криминалистическое обеспечение безопасности компьютерной информации. Монография

- Автор:

- Жанр:

- Издательство:Литагент Кнорус

- Год:2015

- Город:Москва

- ISBN:978-5-4365-0316-5

- Рейтинг:

- Избранное:Добавить в избранное

-

Отзывы:

-

Ваша оценка:

Александр Сотов - Компьютерная информация под защитой. Правовое и криминалистическое обеспечение безопасности компьютерной информации. Монография краткое содержание

Компьютерная информация под защитой. Правовое и криминалистическое обеспечение безопасности компьютерной информации. Монография - читать онлайн бесплатно ознакомительный отрывок

Интервал:

Закладка:

Напротив, группа ученых Принстонского университета, членом которой являлся известный американский математик венгерского происхождения Джон (Янош) фон Нейман [5] Burks A. W., Goldstine H. H., Neumann J. «Preliminary Discussion of the Logical Design of an Electronic Computing Instrument». Princeton, N. J., July 1946. О содержании статьи на русском языке см. Смирнов А. Д. «Архитектура вычислительных систем: Учебное пособие для вузов» – М.: Наука, 1990

, полагала, что «память» и «программы» должны находиться в одном аппаратном устройстве. То есть, команды и числа, которые с помощью этих команд обрабатываются, находятся в одинаковых ячейках, которые последовательно обрабатываются. Это, в свою очередь, требовало, чтобы как данные, так и команды по их обработке, писались на одном и том же языке, причем и над программами, и над данными можно было выполнять одни и те же операции. Данный принцип, именуемый «принципом единства памяти», стал отличительным признаком «архитектуры фон Неймана».

Уязвимым местом неймановской архитектуры являлось введение данных. Устройство Эйкена могло принимать данные в привычной для человека десятичной форме исчисления. При такой форме все числа описываются с помощью десяти различных знаков – от 0 до 9.

Архитектура Неймана этого не позволяла. Но для решения проблемы группой Неймана был найден оригинальный путь, который, в конечном счете, и предопределил почти повсеместную победу «неймановской архитектуры», а также привел к появлению компьютера в традиционном понимании.

Этот путь заключался в использовании двоичного кода. При двоичном коде все числа записываются с помощью двух знаков – 0 и 1. В двоичном коде нулю соответствует 0, единице – 1, а вот число «2» в двоичном коде пишется как «10». «3» выражается «11», «4» – это 100 и т. д.

Существенным достоинством двоичного кодирования является то, что оно позволило «материализовать» информацию, перевести ее из области абстрактного сигнала в область «материала», который может быть подвергнут обработке с помощью технических средств. Сигнал либо есть (1), либо его нет (0). «Память» компьютера состоит из огромного количества элементарных электромагнитных устройств, которые либо испускают электрические импульсы (что для устройства обработки является 1), либо не испускают (это дает 0). Если сигнал меняется с 1 на 0, это означает уменьшение числа, то есть вычитание, а если с 0 на 1 – это сложение. Конечно, запись даже небольшого числа вроде 32 и арифметических операций с ним в двоичном коде выглядит очень громоздко, но скорость считывания сигналов уравновешивала все недостатки.

Первоначально элементарные устройства были заметных размеров, и считывание сигналов с них было относительно долгим. Но широкое внедрение полупроводников, микросхем и пр. позволили кардинально уменьшить размеры вычислительных устройств и одновременно повысить их быстродействие.

Тем не менее, вплоть до настоящего момента все компьютеры, как и их далекие предшественники, могут только складывать и вычитать числа, записанные в двоичном коде, но делают это гораздо быстрее.

Следует отметить, что использование двоичного кода далеко не сразу было признано единственно верным решением. Как уже говорилось, имелись варианты систем, работающих в десятичной системе. Можно также упомянуть оригинальный эксперимент, осуществленный в СССР при создании вычислительного устройства, работающего в троичном коде (машина «Сетунь» [6] Н. А. Криницкий, Г. А. Миронов, Г. Д. Фролов. «Программирование», Государственное издательство физико-математической литературы, Москва, 1963 (Глава 10 Программно-управляемая машина «Сетунь»).

).

Благодаря двоичному коду появилась не только возможность аппаратной обработки информации. Ее стало возможным измерить. Элементарной единицей информации является бит. Он означает либо отсутствие сигнала (0 бит), либо наличие сигнала (1 бит). Соответственно, 1 в двоичном коде – 1 бит информации.

Но если компьютер как аппаратное устройство оперирует именно битами, то человек как пользователь должен пользоваться более привычными ему символами. Опытным путем было установлено, что все символы могут быть описаны для компьютера числами двоичного кода, не превышающими 8 разрядов (всего 256 чисел). Иначе говоря, символ (буква, пробел, цифра) может быть описан с помощью 8 бит. Это количество информации получило наименование «байт». Например, если в произведении 32 000 знаков (включая пробелы, можно сказать, что его информационный объем составляет 32 000 байт).

Следует отметить, что образование кратных единиц измерения количества информации несколько отличается от принятых в большинстве наук. Традиционные метрические системы единиц в качестве множителей кратных единиц используют коэффициент 10n, где n = 3, 6, 9 и так далее, что соответствует десятичным приставкам Кило (10 3), Мега (10 6), Гига (10 9) и так далее. Поскольку компьютер оперирует числами не в десятичной, а в двоичной системе счисления, в кратных единицах измерения количества информации используется коэффициент 2n. Поэтому кратные байту единицы измерения количества информации вводятся следующим образом:

1 Кбайт = 2 10байт = 1024 байт

1 Мбайт = 2 10Кбайт = 1024 Кбайт

1 Гбайт = 2 10Мбайт = 1024 Мбайт

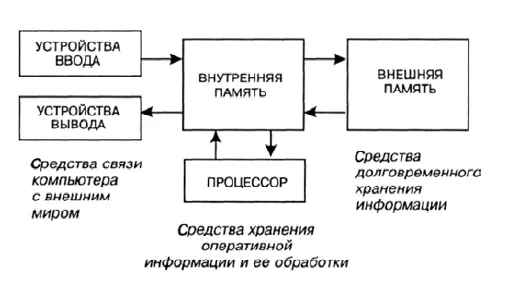

Современный компьютер, построенный по принципу «архитектуры Неймана», состоит из следующих основных элементов:

Для большинства пользователей устройствами ввода служат клавиатура, джойстик, дисководы, видеокамеры и пр. Устройствами вывода являются монитор или принтер.

Процессор объединяет в себе устройство управления и арифметически-логическое устройство. Он постоянно находится в рабочем состоянии благодаря имеющемуся у него элементу питания. Но устройств для хранения данных (памяти) у него нет [7] С технической точки зрения процессоры обладают небольшими, но исключительно быстродоступными хранилищами данных (памятью), которая именуется «кэшпамятью». Основное назначение КЭШа – сохранять промежуточные результаты вычислений (грубая аналогия – функция запоминания в арифметических микрокалькуляторах), то есть функция прежде всего служебная. При команде обратиться к оперативной памяти процессор предварительно «просматривает» кэш, что не занимает много времени в связи с его маленьким объемом. Если необходимая информация там имеется, данные берутся из кэша, что позволяет еще больше увеличить быстродействие.

. Поэтому он конструктивно объединен с «внутренней памятью» – ОЗУ, RAM (оперативным запоминающим устройством, оперативная память). В отличие от процессора, ОЗУ зависит от внешнего питания, поэтому, когда подача энергии на ОЗУ прекращается, прекращается и функционирование процессора – ему неоткуда брать данные. Но благодаря объединению в один блок взаимодействие процессора с оперативной памятью происходит очень быстро. Все процессы обработки информации происходят именно в ОЗУ. Поэтому большой объем оперативной памяти является весьма существенным фактором быстродействия. Если же для выполнения команды требуется обработать больший объем данных, чем позволяет оперативная память, в работе компьютера наступает сбой. Информация, которая хранится в ОЗУ, уничтожается после выключения компьютера.

Интервал:

Закладка: