Лев Шеромов - Прозрение

- Название:Прозрение

- Автор:

- Жанр:

- Издательство:Литагент Литео

- Год:неизвестен

- ISBN:9785000715741

- Рейтинг:

- Избранное:Добавить в избранное

-

Отзывы:

-

Ваша оценка:

Лев Шеромов - Прозрение краткое содержание

Прозрение - читать онлайн бесплатно ознакомительный отрывок

Интервал:

Закладка:

Из этого рисунка видно, что беспорядок (хаос) нарастает, растет неопределенность реального состояния системы. Вероятность осуществления некоторого состояния после каждой точки бифуркации падает. Кроме того, вернуться назад во времени невозможно (необратимость!) . Получается, что этот возврат придется делать при условии, что система перешла после точки бифуркации именно в то состояние, из которого мы хотим вернуться назад. Но ведь она могла перейти и в другое состояние. Математически обратный переход можно выразить формулой, но только с применением понятия условной вероятности. То есть попасть точно назад, нет никакой гарантии. Это и есть закон о необратимости природных явлений . Второй закон термодинамики является частным случаем этого, более общего закона.

Теперь мы видим объяснение нашего примера с возвращением в начало пути, приведенного выше, без термодинамики (где мы «попали в ловушку»).

Приведем еще аналогию возникновения этих разветвлений из обыденной жизни. Допустим, мы путешествуем по некоторой местности. Идем по тропинке, и нам встречается развилка. И нет информации – куда свернуть? Пошли наугад, направо. Идем дальше, встречается перекресток, опять та же проблема, какую дорогу выбрать? И если это «путешествие» продолжить, то неопределенность нашего местонахождения возрастает. Особенно часто такая ситуация возникает, когда теряются дети. В какую сторону ребенок мог пойти?!

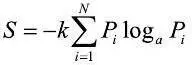

Достаточно принять эту аксиому, то далее, известная формула Клода Шеннона для информационной энтропии может быть выведена строго математически (см. приложение).

Формула Шеннона:

где S – энтропия, – вероятности возможных состояний системы i=1, 2… N ) в каждый момент времени,

k и a – произвольные постоянные.

В теории информации k =1; a =2.

Но вернемся в термодинамику. Нет ли там такой же формулы? Случайных, необратимых явлений там сколько угодно. Да и сама термодинамическая система состоит из множества хаотически (случайно) движущихся частиц. В термодинамике эта формула аналогична, но k – постоянная Больцмана, a – основание натуральных логарифмов. Людвиг Больцман вывел формулу для термодинамической энтропии раньше К. Шеннона (на 60 лет), но последний, получил ее заново и для более общего случая. Это подтверждает универсальный характер понятия энтропии. Нет принципиальной разницы между информационной и термодинамической энтропией.

Но при выводе формулы Больцмана использовалось понятие изолированной термодинамической системы, а при выводе формулы Шеннона такого ограничения не накладывалось. Это несоответствие кажущееся и связано с тем, что термодинамика исторически всегда была связана с системами ограниченными по массе и объему. Это позволяло делать конкретные выводы и практические расчеты. «Анализ процессов, происходящих в изолированной системе, представляет интерес в большой мере потому, что в пределе любую изолированную систему и окружающую среду можно мысленно рассматривать как единую изолированную систему» [10]. Поэтому не приходится сомневаться в том, что необратимость присутствует не только в термодинамических системах, а и во всех других, где применима приведенная выше аксиома о точках бифуркации.

Опыт показывает, что многие люди не знают точного определения понятия «вероятность». Для них в приложении приведен простой пример расчета энтропии по приведенной выше формуле. Вероятность меняется от нуля до единицы (достоверное событие). В обиходе иногда принимают вероятность от нуля до ста процентов.

Вывод этой формулы сделан при учете только самых простых и общих предпосылок (рис. 1). При этом не вводились никакие энергетические ограничения. Поэтому из этой формулы следует, что энтропия всегда растет, в любых материальных системах. Причем расчет по этой формуле показывает, что скорость возрастания энтропии тем выше, чем ближе друг к другу вероятности перехода из точки бифуркации в возможные состояния. Например, – при P 1= P 2 на рисунке 1.

В соответствии с этой формулой энтропия никогда не может самопроизвольно снижаться.

Взглянем ещё раз на формулу Шеннона. В каких единицах измеряется энтропия? Вероятности P безразмерны, значит, размерность энтропии равна размерности произвольной постоянной k , которая по своей сути может быть любой. Принято принимать размерность этой величины, исходя из сущности рассматриваемой системы. В теории информации она имеет размерность в битах, в термодинамике, – в Дж/(кг·К). В любой другой системе необходимо описать два близких во времени состояния и вычислить вероятность второго по отношению к первому. Или определить её опытным путем. Тогда безразмерная часть формулы Шеннона будет определена. А размерность энтропии будет равна размерности сделанных описаний изучаемой системы. Если они имеют физический смысл, то и размерность будет иметь физическую природу. Если же в описании нет физического смысла, например, описание в виде текста из букв, то размерность энтропии совпадает с размерностью информации (бит).

Теперь ясно, формула пригодна для материальных систем любой сущности (живая и неживая природа, человеческие сообщества, любые машины, кибернетические устройства и т.п.). И, конечно, эта формула есть в статистической физике, выведенная великим американским ученым Дж. Гиббсом 2 2 В 1901 г. Гиббс был удостоен высшей награды международного научного сообщества того времени (присуждаемой каждый год только одному учёному) – Медали Копли Лондонского королевского общества – за то, что он стал «первым, кто применил второй закон термодинамики для всестороннего рассмотрения соотношения между химической, электрической и тепловой энергией и способностью к совершению работы»

Но исторически сложилось так, что люди всегда видели в природе явления, которые как будто не подчиняются этому закону. Это, прежде всего, изобретения, технологические приемы в обычной текущей жизни людей. Даже, например, изобретение колеса или способа приготовления пива были явным усложнением простых явлений природы. И тут появляются в девятнадцатом веке тепловые машины, а с ними термодинамика. А с ней и ВТОРОЙ ЗАКОН! Он вызвал большую неразбериху в науке и множество яростных споров, которые со временем поутихли, кроме одной совершенно непонятной проблемы. Дело в том, что появившаяся в это же время теория эволюции Дарвина явно, как казалось, нарушала второй закон термодинамики. Налицо был колоссальный процесс усложнения, упорядочивания материи.

Читать дальшеИнтервал:

Закладка: