Анджей Ясинский - Ник. Чародей

- Название:Ник. Чародей

- Автор:

- Жанр:

- Издательство:неизвестно

- Год:неизвестен

- ISBN:нет данных

- Рейтинг:

- Избранное:Добавить в избранное

-

Отзывы:

-

Ваша оценка:

Анджей Ясинский - Ник. Чародей краткое содержание

##1 Читать приложение стоит только тем, кто интересуется физическими законами, описанными в цикле «Ник», кому интересно, почему информация является базовым фундаментом мироздания. Однако понимание или непонимание приведенных дальше формул никак не влияет на восприятие всей книги.

Ник. Чародей - читать онлайн бесплатно ознакомительный отрывок

Интервал:

Закладка:

И теперь Ник с Кариной в сопровождении Шойнца и Лулио движутся по реке, а Балаватх с Лилиейлой летят на опережение в резиденцию отца Карины, в то время как оробосские агенты ищут выходы и договариваются о встрече. Рискованно, конечно, но так надоели уже все эти "нити управления" и "астральные реверансы", хочется наконец-то встретиться со всеми на материальном плане, лицом к лицу, получить ответы и разгадать годами мучащие загадки. А может быть, и получить множество новых! Как тогда, когда они познакомились с Ником на выступлениях Лиги в столице гномов. Демон усмехнулся. Как в старые добрые времена. Только теперь вместо показательных выступлений Лиги в качестве декораций будет турнир големов в Оробосе!

Приложение

Инфофизика

(физика четвертого измерения)

##1 Читать приложение стоит только тем, кто интересуется физическими законами, описанными в цикле «Ник», кому интересно, почему информация является базовым фундаментом мироздания. Однако понимание или непонимание приведенных дальше формул никак не влияет на восприятие всей книги.

Введение

При описании физических процессов самым главным шагом является выбор базовых параметров процессов, от которых зависит, какие математические инструменты понадобятся для решения конкретной задачи. Исходя из этого, физика разделяется на разные направления, которые используют свои наборы параметров и соотношения между ними. Так, например, классическая механика в качестве параметров использует импульсы и энергию, в то время как электродинамика описывает процессы на языке напряженностей полей. Для того чтобы объединить различные разделы физики в единую картину, в первую очередь нужно найти общие параметры процессов, которые присутствуют во всех подходах. На сегодняшний день наиболее общим параметром можно считать энергию, так как данная сущность присутствует во всех направлениях физики. Хотя при использовании данного параметра в качестве базового возникает проблема расплывчатости представлений об энергии. Очень много видов энергии используется для описания физических процессов, и часто возникают затруднения в понимании физического смысла данной величины. В результате некоторые разделы физики в настоящее время очень плохо согласуются между собой. Возможно, более перспективным направлением является выбор другой базовой физической сущности, на основе которой можно описывать физические процессы.

В основе данной работы лежит попытка описания физических процессов с точки зрения новой физической величины, совпадающей с определением количества информации в математической теории информации. Для определения данной величины у физических объектов потребовалось ввести условие существования у них конечных размеров по всем осям четырехмерного пространства. Такой постулат немного расходится с представлениями классической механики, рассматривающей движение материальных точек, но в то же время он гораздо лучше согласуется с реальной физической картиной. Вторым шагом определения информации явился перенос рассмотрения физических процессов в четырехмерное Евклидово пространство. С математической точки зрения, такой переход выразился в умножении времени на комплексную константу ic , в результате чего пространство Минковского стало Евклидовым. На данном этапе будем рассматривать этот шаг просто как математический прием, позволяющий рассматривать координаты и время в качестве равнозначных параметров.

В данной работе все рассуждения производятся на основе рассмотрения произвольного физического объекта, состоящего из двух взаимодействующих частиц. В дальнейшем можно будет расширить картину и применить данные рассуждения к более широкому классу объектов.

Забегая немного вперед, скажем, что введенная нами физическая информация совпала с функционалом действия, определенным в классической механике, а ее производная по времени является лагранжианом объекта. Кроме того, функция информации удовлетворяет уравнению Шредингера, и ее свойства очень хорошо согласуются с принципами квантовой механики. Такие результаты, полученные сразу после определения функции информации, говорят о перспективности использования понятия информации в качестве базовой физической величины при рассмотрении многих процессов.

1. Понятие информации

В математике теория информации (математическая теория связи) — раздел прикладной математики, определяющий понятие информации, ее свойства и устанавливающий предельные соотношения для систем передачи данных. Основные разделы теории информации — кодирование источника (сжимающее кодирование) и канальное (помехоустойчивое) кодирование.

Информация не входит в число предметов исследования математики. Тем не менее слово «информация» употребляется в математических терминах «собственная информация» и «взаимная информация», относящихся к абстрактной (математической) части теории информации. Однако в математической теории понятие «информация» связано с исключительно абстрактными объектами — случайными величинами, в то время как в современной теории информации это понятие рассматривается значительно шире — как свойство материальных объектов.

Связь между этими двумя одинаковыми терминами несомненна. Именно математический аппарат случайных чисел использовал автор теории информации Клод Шеннон. Сам он подразумевает под термином «информация» нечто фундаментальное (нередуцируемое). В теории Шеннона интуитивно полагается, что информация имеет содержание. Информация уменьшает общую неопределенность и информационную энтропию. Количество информации доступно измерению. Однако он предостерегает исследователей от механического переноса понятий из его теории в другие области науки.

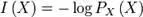

Собственная информация — статистическая функция дискретной случайной величины.

Для случайной величины X, имеющей конечное число значений:

(1.1)

(1.1)

собственная информация определяется как

(1.2).

(1.2).

Из данного определения видно, что понятие информации тесно связано с понятием «события» и его вероятностью. Отсюда можно сделать вывод, что наиболее близкими к теории информации, разделами физики будут теория относительности и квантовая механика.

В теории относительности любое событие — это всегда элементарное событие, которое можно однозначно идентифицировать с помощью четырех пространственно-временных координат (xi = ( t, x, y, z)), заданных в конкретной системе отсчета.

Читать дальшеИнтервал:

Закладка:

![Анджей Ясинский - Ник (Часть 1-2) [СИ]](/books/178975/andzhej-yasinskij-nik-chast-1-2-si.webp)