Стюарт Рассел - Совместимость. Как контролировать искусственный интеллект

- Название:Совместимость. Как контролировать искусственный интеллект

- Автор:

- Жанр:

- Издательство:Альпина нон-фикшн

- Год:2021

- Город:Москва

- ISBN:978-5-0013-9370-2

- Рейтинг:

- Избранное:Добавить в избранное

-

Отзывы:

-

Ваша оценка:

Стюарт Рассел - Совместимость. Как контролировать искусственный интеллект краткое содержание

В своей новаторской книге автор рассказывает, каким образом люди уже научились использовать ИИ, в диапазоне от смертельного автономного оружия до манипуляций нашими предпочтениями, и чему еще смогут его научить. Если это случится и появится сверхчеловеческий ИИ, мы столкнемся с сущностью, намного более могущественной, чем мы сами. Как гарантировать, что человек не окажется в подчинении у сверхинтеллекта?

Для этого, полагает Рассел, искусственный интеллект должен строиться на новых принципах. Машины должны быть скромными и альтруистичными и решать наши задачи, а не свои собственные.

О том, что это за принципы и как их реализовать, читатель узнает из этой книги, которую самые авторитетные издания в мире назвали главной книгой об искусственном интеллекте.

Все, что может предложить цивилизация, является продуктом нашего интеллекта; обретение доступа к существенно превосходящим интеллектуальным возможностям стало бы величайшим событием в истории. Цель этой книги — объяснить, почему оно может стать последним событием цивилизации и как нам исключить такой исход.

Введение понятия полезности — невидимого свойства — для объяснения человеческого поведения посредством математической теории было потрясающим для своего времени. Тем более что, в отличие от денежных сумм, ценность разных ставок и призов с точки зрения полезности недоступна для прямого наблюдения.

Первыми, кто действительно выиграет от появления роботов в доме, станут престарелые и немощные, которым полезный робот может обеспечить определенную степень независимости, недостижимую иными средствами. Даже если робот выполняет ограниченный круг заданий и имеет лишь зачаточное понимание происходящего, он может быть очень полезным.

Очевидно, действия лояльных машин должны будут ограничиваться правилами и запретами, как действия людей ограничиваются законами и социальными нормами. Некоторые специалисты предлагают в качестве решения безусловную ответственность.

Совместимость. Как контролировать искусственный интеллект - читать онлайн бесплатно ознакомительный отрывок

Интервал:

Закладка:

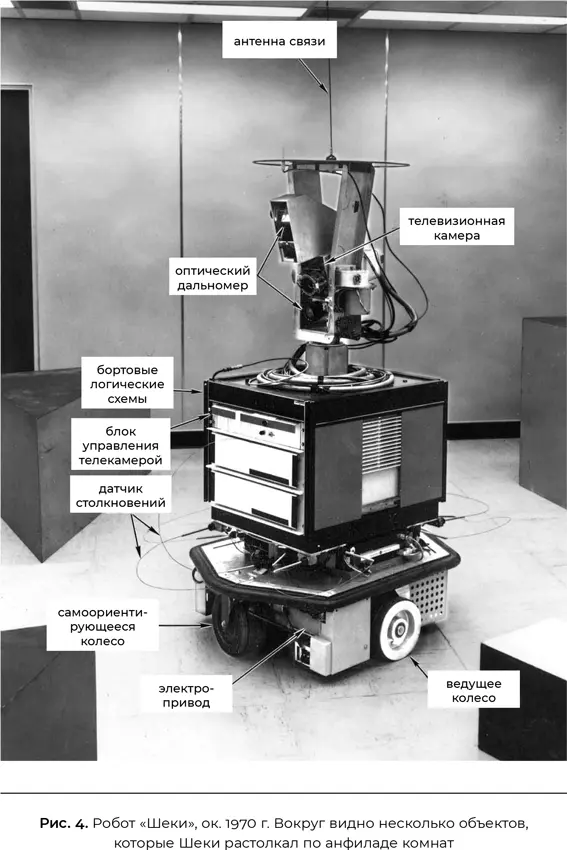

К сожалению, Аристотель (и Маккарти) были правы далеко не полностью. Главной проблемой является невежество — разумеется, не Аристотеля или Маккарти, а всех людей и машин, настоящих и будущих. Лишь в очень немногом из нашего знания мы абсолютно уверены. Особенно важно, что мы очень мало знаем о будущем. Невежество — прямо-таки непреодолимая проблема для чисто логической системы. Если я спрошу: «Приеду ли я вовремя в аэропорт, если выйду за три часа до вылета?» или «Смогу ли я обзавестись домом, купив выигрышный лотерейный билет и приобретя дом на выигрыш?» — правильным ответом будет: «Не знаю». Дело в том, что на любой из вопросов с точки зрения логики одинаково возможны ответы «да» и «нет». На практике невозможно быть совершенно уверенным в ответе на любой эмпирический вопрос, если ответ еще не известен [66] Возникает вопрос, как логический робот Shekey вообще приходил к каким-либо определенным выводам о том, что делать. Ответ прост: база знаний Shekey включала ложные предположения. Например, он был убежден, что, если выполнить «протолкнуть объект А через дверь Г в комнату Б», то объект А в результате окажется в комнате Б. Это было ложное убеждение, потому что Shekey мог застрять в дверях, промахнуться мимо двери, или кто-то мог коварно похитить объект А у него из захвата. Его модуль выполнения плана был способен зарегистрировать провал плана и провести соответствующее перепланирование, так что, строго говоря, Shekey не был чисто логической системой.

. К счастью, определенность совершенно не обязательна для того, чтобы действовать: нам достаточно знать, какое действие является наилучшим, а не какое обречено на успех.

В силу неопределенности «заложенное в машину назначение» не может, в общем, быть точно известной целью, которой следует добиваться любой ценой. Больше не существует такой вещи, как «последовательность действий, достигающая цели», поскольку любая последовательность действий будет иметь множественные результаты, часть которых не достигнет цели. Вероятность успеха действительно важна: выехав в аэропорт за три часа до вылета, вы, возможно , не опоздаете на самолет, а купив лотерейный билет, возможно , выиграете достаточно, чтобы купить новый дом, но это очень разные возможно . Вы не можете гарантировать достижение цели, даже выбирая план, максимизирующий вероятность ее достижения. План с наибольшей вероятностью поспеть на рейс может предполагать выезд из дома за несколько дней, организацию вооруженного эскорта, готовность разнообразных альтернативных средств транспорта на случай, если другие сломаются, и т. д. Неизбежно приходится принимать в расчет относительную желательность каждого исхода, а также его вероятность.

Таким образом, вместо цели мы можем использовать функцию полезности для описания желательности разных исходов или последовательностей состояний. Часто полезность последовательности состояний выражается в сумме вознаграждений за каждое состояние в последовательности. Если цель определена через функцию полезности или вознаграждения, машина ориентируется на поведение, максимизирующее ожидаемую полезность или ожидаемую сумму вознаграждений, усредненных по возможным результатам с весами-вероятностями. Современный ИИ отчасти возрождает мечту Маккарти, только с полезностями и вероятностями вместо целей и логики.

Пьер-Симон Лаплас, великий французский математик, писал в 1814 г.: «Теория вероятности есть обычный здравый смысл, сведенный к расчетам» [67] Ранние замечания о роли вероятности в человеческом мышлении: Pierre-Simon Laplace , Essai philosophique sur les probabilités (Mme. Ve. Courcier, 1814).

. Однако только в 1980-х гг. были разработаны практический формальный язык и алгоритмы формирования рассуждений для вероятностного знания. Это был язык Байесовых сетей В, предложенный Джудой Перлом. Попросту говоря, Байесовы сети — вероятностные родственники пропозиционной логики. Они также являются вероятностным подобием логики первого порядка, в том числе Байесовой логики [68] Описание Байесовой логики доступным языком: Stuart Russell, «Unifying logic and probability», Communications of the ACM 58 (2015): 88–97. Статья опирается на исследование моего бывшего студента Брайана Милча, проведенное в ходе работы над диссертацией на соискание звания доктора философии.

и большого разнообразия языков вероятностного программирования .

Байесовы сети и Байесова логика названы в честь преподобного Томаса Байеса, британского священника, наследие которого для современной мысли, ныне известное как теорема Байеса , было опубликовано в 1763 г., вскоре после его смерти, его другом Ричардом Прайсом [69] Источник теоремы Байеса: Thomas Bayes and Richard Price, «An essay towards solving a problem in the doctrine of chances », Philosophical Transactions of the Royal Society of London 53 (1763): 370–418.

. В своем современном виде, предложенном Лапласом, теорема очень простым способом описывает то, как априорная вероятность — первоначальная степень уверенности в системе возможных гипотез — становится апостериорной вероятностью в результате наблюдения некоторых подтверждающих свидетельств. По мере появления новых свидетельств апостериорность становится новой априорностью, и процесс Байесова обновления повторяется бесконечно. Это фундаментальный процесс, и современное понятие рациональности как максимизации ожидаемой полезности иногда называют Байесовой рациональностью . Предполагается, что рациональный агент имеет доступ к распределению апостериорной вероятности в возможных текущих состояниях мира, а также в гипотезах о будущем с опорой на весь свой прошлый опыт.

Специалисты в области исследования операций, теории управления и ИИ также разработали разнообразные алгоритмы принятия решений в условиях неопределенности, часть которых восходит к 1950-м гг. Эти так называемые алгоритмы «динамического программирования» являются вероятностными родственниками опережающего поиска и планирования и могут генерировать оптимальное или близкое к оптимальному поведение в отношении всевозможных практических задач в финансах, логистике, транспорте и т. д., в которых неопределенность играет существенную роль В. Задача состоит в том, чтобы ввести их в машины в форме функции вознаграждения, а на выходе получить политику , определяемую как действие в каждом возможном состоянии, в которое агент может себя ввести.

В случае таких сложных задач, как нарды и го, где число состояний колоссально, а вознаграждение появляется лишь в конце игры, опережающий поиск не работает. Вместо него исследователи ИИ разработали метод так называемого обучения с подкреплением . Алгоритмы обучения с подкреплением учатся на непосредственном опыте получения вознаграждающих сигналов из среды, во многом так же, как младенец учится стоять, получая позитивное вознаграждение за нахождение в вертикальном положении и негативное за падение. Как и в отношении алгоритмов динамического программирования, задачей, вводимой в алгоритм обучения с подкреплением, является функция вознаграждения, и алгоритм изучает оценочный модуль ценности состояний (иногда ценности действий). Оценочный модуль может сочетаться с относительно неточным предварительным поиском для генерирования высококомпетентного поведения.

Читать дальшеИнтервал:

Закладка:

![Мередит Бруссард - Искусственный интеллект [Пределы возможного] [litres]](/books/1073206/meredit-brussard-iskusstvennyj-intellekt-predely.webp)